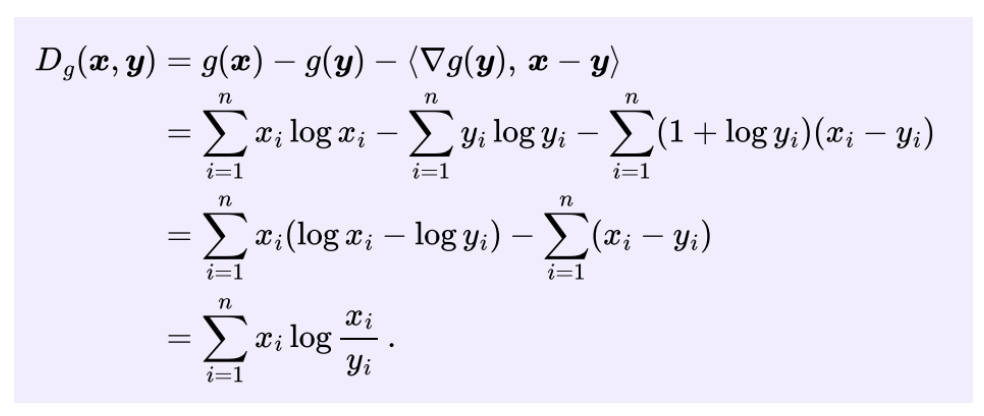

Relative Entropy

这里我们见到了老朋友

KL distance 是非负量,从最优化的视角下是因为其实际上是 Bregman Divergence 的一个特例(在这门课上也是用凸函数的性质证明的)

在这门课上,他被叫做两个函数的相对熵。需要注意,相对熵不是一个测度,因为不满足交换律,而且不完全符合正定性

在这门课上,他被叫做两个函数的相对熵。需要注意,相对熵不是一个测度,因为不满足交换律,而且不完全符合正定性

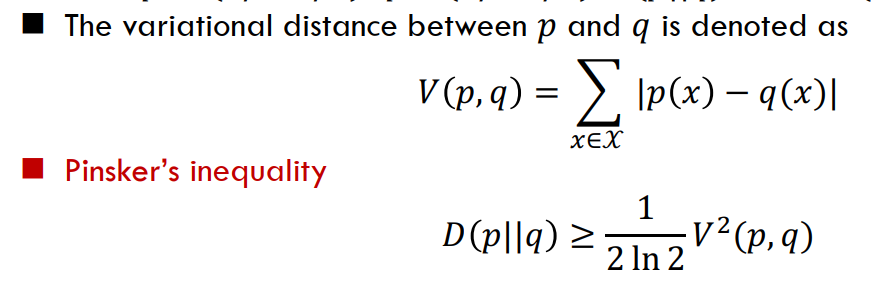

其满足的一个不等式性质为:

Mutual Information

这就是就是前面说的

即知道

几个基本的运算性质

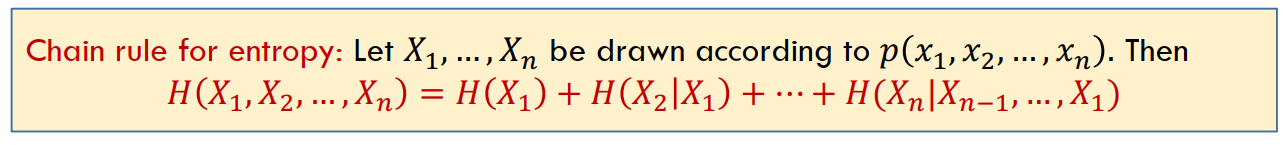

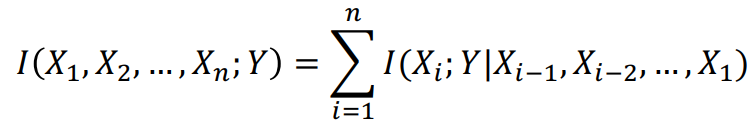

更一般的 Chain Rule

基于

取对后求期望易得

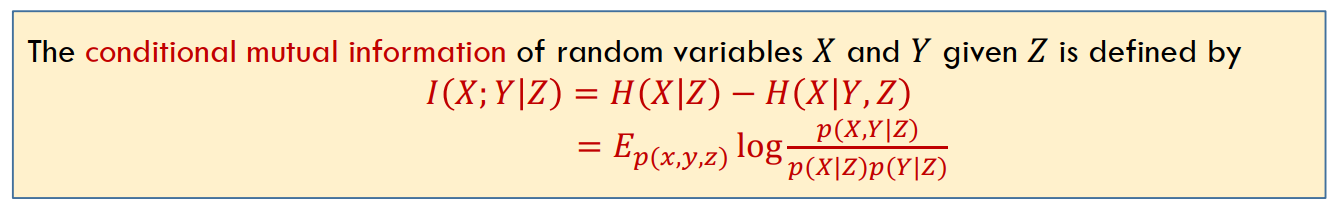

Conditional Mutual Information

定义

则根据链式法则,得到

这里的

而

也就是 “在③的条件下,知道②对①的信息增量”

将

Conditional Relative Entropy

这个比较复杂,条件相对熵就是

由这个式子易知